在當今以數據驅動的商業時代,京東作為中國領先的電商與科技企業,其背后強大而高效的大數據技術體系是其核心競爭力之一。從海量用戶行為的實時捕捉,到復雜數據流的精準處理,再到超大規模數據的可靠存儲與智能服務,京東構建了一套貫穿“數據采集、數據處理、數據存儲與服務支持”的全鏈路技術棧。本文將深入揭秘這一體系的核心環節與技術實踐。

一、數據采集:全域觸點的實時與批量匯聚

京東的數據采集體系旨在實現“全、快、準”的數據獲取。面對每日產生的PB級數據,其采集系統覆蓋了用戶端、商家端、物流端及內部系統等多個維度。

- 多源異構數據接入:系統通過自主研發的“京東數據總線”(JDBus),統一對接來自App、PC網站、小程序、IoT設備、服務器日志、數據庫Binlog等不同源頭的數據。無論是用戶點擊、搜索、下單的實時事件流,還是商品信息、庫存變化的批量數據,都能被高效捕獲。

- 實時與離線雙鏈路:為了平衡即時性與成本,京東構建了實時采集與離線采集雙通道。實時鏈路基于高性能消息隊列(如JMQ/Kafka),確保秒級延遲,支撐實時推薦、風控等場景;離線鏈路則通過分布式日志收集工具(如Flume)及定期數據同步工具,高效匯聚海量歷史數據,用于深度分析與模型訓練。

- 數據質量與安全保障:在采集端即嵌入數據校驗規則,對關鍵字段進行非空、格式、合法性校驗。通過數據脫敏、加密傳輸等手段,嚴格保障用戶隱私與數據安全,確保數據從源頭可信。

二、數據處理:流批一體的計算引擎與平臺化治理

采集而來的原始數據需經過層層加工,才能轉化為有價值的洞察。京東的數據處理體系以“流批一體”為核心,兼顧時效性與準確性。

- 流式計算:實時響應業務脈搏:基于Apache Flink等引擎構建的實時計算平臺,能夠對數據流進行窗口聚合、復雜事件處理(CEP)和實時ETL。例如,實時計算用戶畫像的更新、監控物流異常、計算實時大屏指標,讓業務能夠對瞬息萬變的市場做出即時反應。

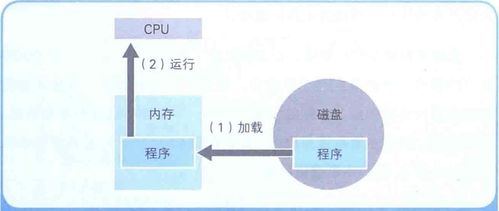

- 批量計算:深度挖掘數據價值:依托Hadoop、Spark等構建的離線計算集群,處理T+1或周期性的海量數據作業。它支撐著數據倉庫(JDW)的構建、用戶行為分析、銷量預測、供應鏈優化等需要全局和歷史視野的復雜任務。京東通過智能資源調度與優化,極大提升了批量作業的執行效率。

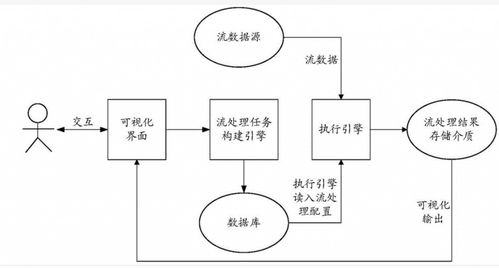

- 數據開發與治理平臺化:為了降低技術門檻,京東內部提供了“數坊”等一站式數據開發平臺。數據工程師和分析師可以通過可視化界面進行任務編排、依賴管理、監控告警。建立了完善的數據資產目錄、數據血緣追蹤和數據質量管理體系,確保數據處理過程可追溯、結果可信任。

三、數據處理和存儲支持服務:穩定、高效、智能的基石

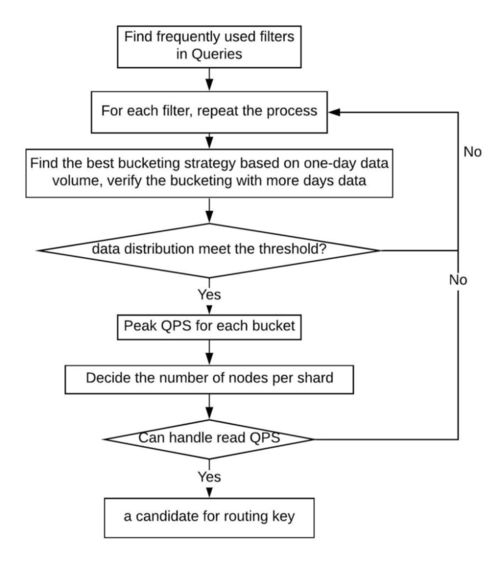

經過處理的數據需要被妥善存儲,并能高效、靈活地服務于上層應用。京東在此環節提供了多層次、多模型的數據存儲與查詢服務。

- 分層存儲架構:根據數據的訪問頻率和成本要求,采用經典的數據湖(Data Lake)與數據倉庫(Data Warehouse)分層架構。

- 原始數據層:將采集的原始數據以低成本對象存儲(如HDFS、OSS)形式保存,保留數據全貌。

- 明細與匯總層:經過清洗、整合的數據,存儲在Hive、ClickHouse等系統中,支持靈活的交互式查詢與分析。

- 應用數據層:為特定高性能場景服務,將數據導入Redis、HBase、Elasticsearch等在線存儲,提供毫秒級讀寫,支撐商品詳情頁、訂單查詢、搜索推薦等核心業務。

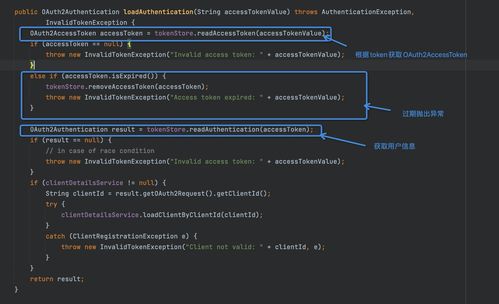

- 統一查詢與數據服務:為了避免“數據孤島”,京東構建了統一的查詢引擎(如Presto/Trino)和數據服務中間件。業務方無需關心數據物理存儲位置,通過標準SQL或API即可跨源查詢。數據服務層將數據封裝成API,穩定、安全地提供給前端應用、算法模型和合作伙伴。

- 存儲優化與智能運維:面對爆炸式增長的數據量,京東通過數據生命周期管理(自動冷熱分層、歸檔與刪除)、智能壓縮算法、存儲格式優化(如ORC/Parquet)等手段持續降低成本。基于AI的智能運維系統對集群健康度、容量進行預測與自動擴縮容,保障存儲服務的超高可用性與穩定性。

###

京東的大數據技術體系,是一條從數據源頭到價值終端的精密的“數據流水線”。它不僅是技術的簡單堆砌,更是業務需求、工程實踐與平臺化運營深度結合的產物。通過持續迭代的采集能力、強大的流批一體處理引擎以及穩定智能的存儲服務支撐,京東確保了數據資產能夠被高效、可靠地轉化為驅動業務增長、優化用戶體驗、提升運營效率的核心動能,為其在零售、物流、科技等領域的持續領先奠定了堅實的數據基石。